A OpenAI, criadora do ChatGPT, foi alvo de um ataque cibernético no início de 2023, resultando no roubo de informações confidenciais sobre as suas tecnologias de IA.

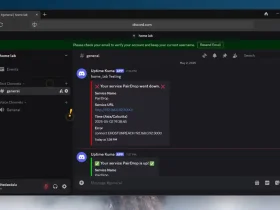

A notícia, divulgada pelo The New York Times, revela que um hacker conseguiu invadir os sistemas de mensagens internos da empresa, expondo detalhes sobre os seus avanços em inteligência artificial.

Funcionários da OpenAI expressam preocupações com segurança

O incidente gerou preocupação entre os funcionários da OpenAI, que temem que tais ataques possam ser explorados por países como a China para roubar tecnologia de IA e potencialmente comprometer a segurança nacional dos EUA.

A revelação do ataque também expôs divisões internas na empresa, com alguns funcionários questionando a seriedade com que a OpenAI estava a tratar a segurança e os riscos da inteligência artificial.

Ex-diretor alerta sobre riscos e é demitido

Leopold Aschenbrenner, ex-diretor do programa técnico da OpenAI, expressou as suas preocupações ao conselho da empresa, alertando sobre a falta de medidas para proteger segredos de adversários estrangeiros.

No entanto, a suas advertências foram recebidas com represálias, resultando na sua demissão por vazar informações.

Aschenbrenner argumenta que a sua demissão foi motivada por razões políticas, levantando questões sobre a transparência e a cultura interna da OpenAI.

Desafios crescentes para a OpenAI

Este incidente se soma a uma série de desafios enfrentados pela OpenAI nos últimos tempos. A empresa já havia passado por conflitos internos, com o CEO Sam Altman enfrentando o conselho anterior e saindo vitorioso.

Além disso, vários pesquisadores de segurança da IA deixaram a empresa devido a divergências sobre o superalinhamento, um conceito que visa encontrar métodos para os humanos controlarem a IA superinteligente.

O futuro da OpenAI em questão

Enquanto alguns especialistas em IA, como Daniela Amodei, co-fundadora da Anthropic, minimizam o impacto do roubo dos projetos de IA generativa da OpenAI na segurança nacional, a situação pode mudar à medida que essa tecnologia se torna mais poderosa.

O incidente levanta questões cruciais sobre a segurança da IA, a ética empresarial e a necessidade de maior transparência e colaboração na indústria de tecnologia.

Deixa um comentário