A Meta lançou hoje os primeiros dois modelos da sua nova suite multimodal Llama 4: o Llama 4 Scout e o Llama 4 Maverick.

Estes modelos representam um avanço significativo na inteligência artificial da empresa, com capacidades multimodais nativas e uma arquitetura inovadora que promete transformar a forma como interagimos com a tecnologia.

Dois modelos poderosos com características distintas

O Llama 4 Maverick é considerado o “cavalo de batalha” dos dois modelos e destaca-se pela sua excelente compreensão de imagem e texto para “casos de uso gerais de assistente e conversação”, segundo informou a empresa num comunicado oficial.

Por outro lado, o modelo mais pequeno, Scout, foi concebido para tarefas como “resumo de múltiplos documentos, análise de atividades extensivas do utilizador para tarefas personalizadas e raciocínio sobre vastas bases de código”.

A Meta também anunciou o Llama 4 Behemoth, um modelo futuro que a empresa afirma estar “entre os LLMs mais inteligentes do mundo”. O CEO Mark Zuckerberg mencionou ainda que teremos notícias sobre um quarto modelo, o Llama 4 Reasoning, “no próximo mês”.

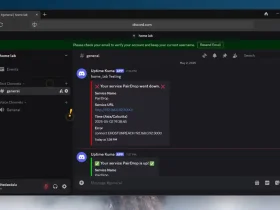

Tanto o Maverick como o Scout já estão disponíveis para download no site oficial do Llama e na plataforma Hugging Face . Além disso, foram integrados no Meta AI, incluindo para WhatsApp, Messenger e mensagens diretas do Instagram.

Especificações técnicas impressionantes que elevam o padrão da indústria

De acordo com a Meta, o Scout possui 17 mil milhões de parâmetros ativos com 16 especialistas. Segundo Zuckerberg, “É extremamente rápido, nativamente multimodal, e tem um comprimento de contexto de quase 10 milhões de tokens, líder na indústria, e foi concebido para funcionar numa única GPU”.

Por outro lado, o Maverick tem 17 mil milhões de parâmetros ativos com 128 especialistas. A empresa afirma que este modelo supera concorrentes como o GPT-4o e o Gemini 2.0 em benchmarks de codificação, raciocínio, multilinguismo, contexto longo e imagem, e equipara-se ao DeepSeek v3.1 em raciocínio e codificação.

Arquitetura inovadora baseada em especialistas para maior eficiência

Os novos modelos Llama 4 são os primeiros da Meta a utilizar uma arquitetura de mistura de especialistas (MoE). Nos modelos MoE, um único token ativa apenas uma fração do total de parâmetros, o que torna estas arquiteturas mais eficientes em termos de computação para treino e inferência.

Por exemplo, os modelos Llama 4 Maverick têm 17 mil milhões de parâmetros ativos e 400 mil milhões de parâmetros totais. A Meta utiliza camadas densas e de mistura de especialistas (MoE) alternadas para eficiência de inferência. As camadas MoE utilizam 128 especialistas encaminhados e um especialista partilhado. Cada token é enviado para o especialista partilhado e também para um dos 128 especialistas encaminhados.

Multimodalidade nativa para uma experiência de utilizador integrada

Os modelos Llama 4 foram concebidos com multimodalidade nativa, incorporando fusão precoce para integrar perfeitamente tokens de texto e visão numa estrutura de modelo unificada. A fusão precoce representa um grande avanço, uma vez que permite pré-treinar conjuntamente o modelo com grandes quantidades de dados não rotulados de texto, imagem e vídeo.

A Meta também melhorou o codificador de visão no Llama 4, baseado no MetaCLIP, mas treinado separadamente em conjunto com um modelo Llama congelado para melhor adaptar o codificador ao LLM.

Behemoth: O gigante que promete redefinir os limites da IA

O Llama 4 Behemoth, ainda em desenvolvimento, promete ser um dos modelos de linguagem mais poderosos do mundo.Com 288 mil milhões de parâmetros ativos, 16 especialistas e quase dois biliões de parâmetros totais, os testes internos da Meta mostram que o Behemoth supera o GPT-4.5, o Claude 3.7 Sonnet e o Gemini 2.0 Pro em várias avaliações que medem competências STEM, como resolução de problemas matemáticos.

Impacto transformador no ecossistema global de inteligência artificial

“Estes modelos Llama 4 marcam o início de uma nova era para o ecossistema Llama”, afirmou a Meta no seu comunicado. A empresa continua a acreditar que a abertura impulsiona a inovação e é benéfica para os programadores, para a Meta e para o mundo.

A disponibilização do Llama 4 Scout e do Llama 4 Maverick para download permite que todos possam continuar a construir novas experiências utilizando a mais recente tecnologia da Meta. Os modelos também estarão disponíveis através dos parceiros da empresa nos próximos dias.

Equilíbrio perfeito entre desempenho superior e eficiência computacional

Um aspeto notável dos novos modelos é o equilíbrio entre desempenho e eficiência. O Scout pode funcionar numa única GPU Nvidia H100, enquanto o Maverick requer um sistema Nvidia H100 DGX ou equivalente, de acordo com os cálculos da Meta.

Esta eficiência é particularmente importante num momento em que o custo computacional e energético dos grandes modelos de IA tem sido alvo de preocupação na indústria.

O futuro promissor da IA multimodal nas mãos dos criadores

A Meta acredita que os sistemas mais inteligentes precisam de ser capazes de realizar ações generalizadas, conversar naturalmente com humanos e resolver problemas desafiantes que nunca viram antes. Dar “superpoderes” ao Llama nestas áreas levará a melhores produtos para as pessoas nas plataformas da Meta e mais oportunidades para os programadores inovarem nos próximos grandes casos de uso para consumidores e empresas.

A empresa continua a investigar e a criar protótipos tanto de modelos como de produtos, e partilhará mais sobre a sua visão na LlamaCon, a 29 de abril.

Seja um programador a construir sobre estes modelos, uma empresa a integrá-los nos seus fluxos de trabalho, ou simplesmente alguém curioso sobre os potenciais usos e benefícios da IA, o Llama 4 Scout e o Llama 4 Maverick representam escolhas de excelência para adicionar inteligência de próxima geração aos produtos e serviços.

Com esta nova geração de modelos, a Meta reafirma a sua posição como uma das principais inovadoras no campo da inteligência artificial, oferecendo ferramentas poderosas e acessíveis que prometem transformar a forma como interagimos com a tecnologia no futuro próximo.

Deixa um comentário