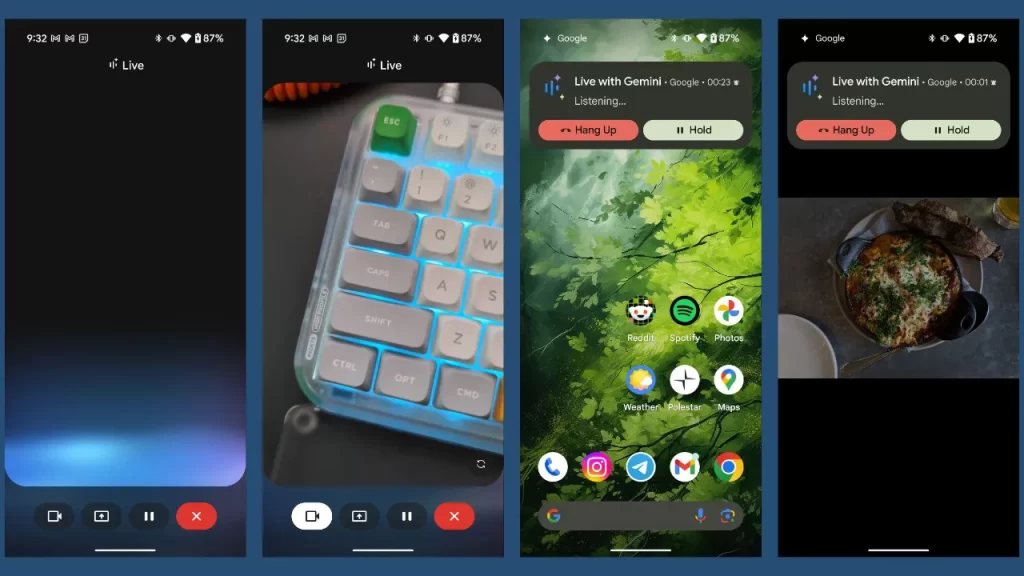

A Google começou a disponibilizar a nova funcionalidade Gemini Live para todos os utilizadores dos modelos Pixel 9 e Galaxy S25. Esta ferramenta, integrada na aplicação Gemini, permite partilhar em tempo real o ecrã ou a câmara do telemóvel com a inteligência artificial da Google, tornando-a capaz de interpretar o mundo que te rodeia.

A funcionalidade já tinha sido anunciada no mês passado, mas só agora chega à totalidade dos equipamentos compatíveis. A partir de agora, a IA da Google deixa de se basear apenas em texto e comandos: pode literalmente ver o que estás a ver.

Como funciona a nova ferramenta de partilha em tempo real

A ativação do Gemini Live é simples. Dentro da aplicação Gemini, basta tocar no botão “Partilhar ecrã com Live” para iniciar a sessão. A partir daí, a inteligência artificial ganha acesso ao conteúdo visível no ecrã ou, se preferires, à imagem captada pela câmara do teu telemóvel.

Durante esta partilha, a IA pode responder a perguntas, sugerir ideias, ajudar a organizar tarefas ou identificar objetos e locais. A Google dá o exemplo da identificação de pratos em fotografias e da sugestão de receitas, adaptadas inclusive a alergias alimentares, caso as indiques.

Outra experiência partilhada envolveu apontar a câmara a uma caneca com figuras decorativas por perto. A IA reconheceu de imediato a presença de um Pokémon — neste caso, o icónico Jigglypuff — mesmo com pouca iluminação.

O que podes fazer com o Gemini Live no dia a dia

Esta nova abordagem à interação com inteligência artificial abre portas a vários casos de utilização práticos:

- Identificação de objetos e produtos: aponta a câmara para algo e a IA explica-te o que é.

- Sugestões criativas em tempo real: mostra à IA uma pintura, um espaço ou um rascunho e recebe ideias para evoluí-lo.

- Feedback sobre trabalhos ou designs: partilha o teu ecrã com uma apresentação ou imagem e recolhe sugestões imediatas.

- Organização da casa: mostra uma divisão e pergunta como a podes tornar mais funcional ou acolhedora.

- Aconselhamento de compras: aponta para algo e a IA pode sugerir alternativas ou locais onde comprar.

Esta funcionalidade torna o Gemini numa ferramenta mais proativa e útil para o dia a dia, especialmente em tarefas que envolvam o mundo visual.

Requisitos e como começar a usar

Para experimentares o Gemini Live, precisas de:

- Um Pixel 9 ou Galaxy S25;

- Ter a versão mais recente da aplicação da Google instalada;

- Uma subscrição do plano Gemini Advanced, caso não tenhas um dos modelos de telemóvel referidos.

A funcionalidade já está a ser disponibilizada globalmente, pelo que deves apenas garantir que a tua aplicação está atualizada através da Play Store.

O que isto significa para o futuro da IA nos smartphones

O Gemini Live mostra uma clara aposta da Google em tornar a inteligência artificial mais intuitiva e visual. Em vez de seres tu a descrever algo com palavras, podes mostrar diretamente o que queres, como se estivesses a conversar com alguém ao teu lado.

A integração do mundo real com o digital é um passo importante rumo a uma experiência mais natural com tecnologia. Se antes a IA era uma entidade abstrata, agora começa a ser algo que participa ativamente no teu dia a dia, interpretando imagens, sugestões e contextos com uma fluidez nunca antes vista num smartphone.

A forma como vais usar esta funcionalidade vai depender da tua criatividade, mas uma coisa é certa: a linha entre o mundo físico e digital está cada vez mais ténue.

Deixa um comentário